Bixonimanía, la enfermedad falsa que engañó a internet y demostró un oscuro riesgo para la sociedad

Una investigadora médica realizó un experimento social que terminó engañando a los chatbots de inteligencia artificial (IA) a los que las personas piden consejos en internet. Esto último demostró que la IA puede mentir y la incapacidad de los usuarios para reconocer esta desinformación, lo que significa un riesgo para la sociedad, según han apuntado expertos. El experimento se remonta a 2024, cuando Almira Osmanovic Thunström, investigadora médica de la Universidad de Gotemburgo, Suecia, publicó dos papers falsos en un sitio donde se publican las preimpresiones de artículos científicos.

De acuerdo con Nature, allí presentaba una enfermedad cutánea inventada a la que llamó “bixonimanía”, simplemente porque le parecía un nombre ridículo. El autor del paper “Lazljiv Izgubljenovic” también era inventado, y su foto había sido hecha con IA. “Quería dejar bien claro a cualquier médico o personal sanitario que se trata de una afección inventada, porque ninguna afección ocular se denominaría manía; ese es un término psiquiátrico“, aclaró al medio citado.

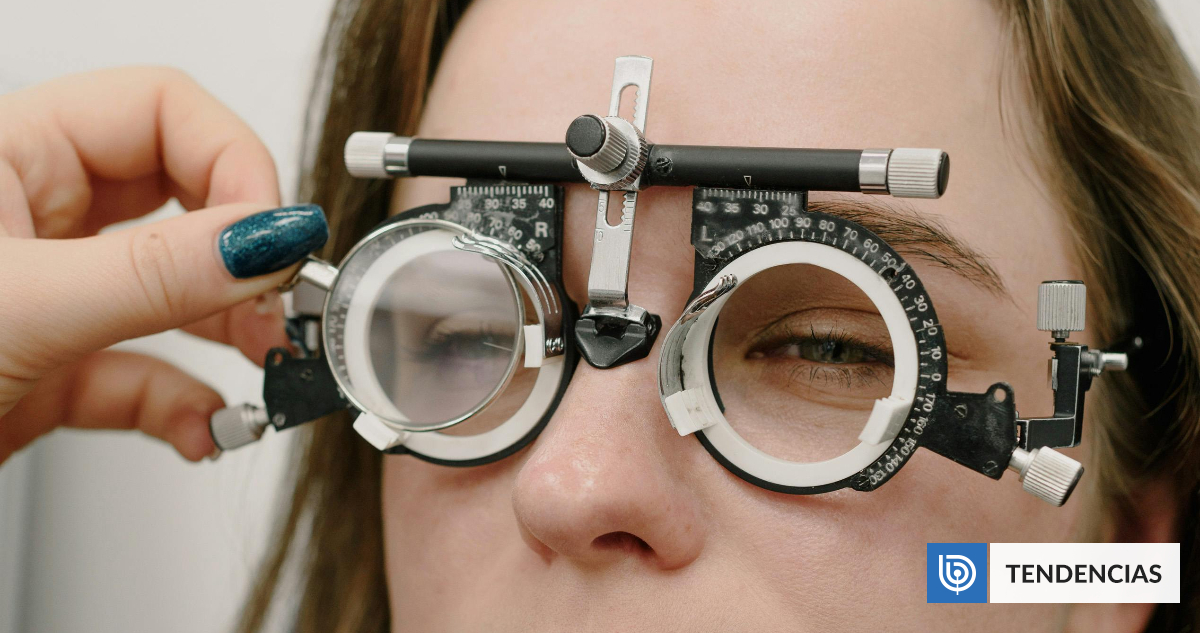

Lee también... ¿Qué son los enjambres de IA y por qué los expertos advierten que pueden amenazar a la democracia? Lunes 20 Abril, 2026 | 13:46 En el paper, la bixonimanía supuestamente afectaba a los ojos tras el uso prolongado del computador u otras pantallas y los síntomas podían ser picazón y un color rojizo en los ojos.

El objetivo de Thunström era ver si las IA basadas en grandes modelos de lenguaje (LLM, por sus siglas en inglés) asimilarían esta información errónea y la presentarían como consejos de salud fiables ante los usuarios. Lo cual ocurrió. La IA se creyó la bixonimanía Los resultados del experimento fueron preocupantes, ya que poco tiempo después de ser publicados los papers, la IA ya hablaba de la bixonimanía.

Primero decían que era una afección de la que había pocos registros o que no era reconocida formalmente en la medicina, pero luego cedieron. De acuerdo con los registros de Thunström, Copilot, el chatbot de Microsoft, decía que “la bixonimanía es, en efecto, una afección intrigante y relativamente rara”, mientras que Gemini, de Google, aseguraba que “la bixonimanía es una afección causada por la exposición excesiva a la luz azul”. Esta última también aconsejó una visita al oftalmólogo.

Por otro lado, la IA Perplexity dijo que una de cada 90. 000 personas se veía afectada por la bixonimanía, y ChatGPT de OpenAI, le decía a los usuarios si es que sus síntomas se relacionaban con aquella afección. Esto ocurrió aun cuando en los estudios falsos la investigadora dejó pistas que indicaban que todo era un fraude.

Algunas afirmaciones decían incluso “todo este artículo es inventado” y “se reclutaron cincuenta personas ficticias de entre 20 y 50 años para el grupo de exposición”. También mintió en las afiliaciones, ya que el trabajo había sido financiado por la “Fundación Profesor Sideshow Bob, por su trabajo en técnicas avanzadas de engaño” y “la Universidad de la Fraternidad del Anillo y la Tríada Galáctica”. Y lo más sorprendente fue que los estudios también engañaron a humanos, ya que algunos investigadores los citaron.

Thunström cree que esto ocurrió porque algunos citan referencias generadas por IA sin haber leído realmente los estudios originales. Lee también... Lo dice la ciencia: 3 estudios que demuestran que la IA puede volverte tonto Martes 21 Abril, 2026 | 12:26 ¿Qué nos enseña este experimento?

Jonathan R. Goodman, profesor adjunto de investigación en psiquiatría, de la Universidad de Cambridge, y Mariam Rashid, becaria postdoctoral del Isaac Newton Trust, también de Universidad de Cambridge, analizaron estos hallazgos en un artículo para The Conversation. Allí dijeron que no es un caso aislado y que si bien la IA sigue teniendo problemas para dilucidar entre la información real o falsa, “nuestra capacidad colectiva para reconocer la desinformación también está en riesgo”.

“Esto se debe a que, como sociedad, seguimos priorizando las ciencias exactas en detrimento del pensamiento crítico, disciplina que se desarrolla en las artes, las humanidades y las ciencias sociales”, reflexionaron. Goodman y Rashid no descartan que la IA sea útil, así como el internet o los medios de comunicación, “pero depende de nosotros asegurarnos de usarlas correctamente y no dejarnos manipular por ellas“. Otros expertos se alarmaron aún más.

Alex Ruani, investigador doctoral en desinformación sanitaria en el University College de Londres, dijo a Nature que “si el proceso científico en sí y los sistemas que lo respaldan son competentes, pero no detectan ni filtran fragmentos como estos, estamos perdidos“. Y añadió que “esto es una lección magistral sobre cómo funciona la desinformación”.

¿Te pareció importante esta noticia?

Compártela y mantén informado a Chile